Overzicht

Adiaforie & Algoritmen &Aanzet

Algoritmiseer niet beslister dan u kunt denken[1]

Adiaforie, ethiek en autonomie

Adiaforie[2] noem ik het verschijnsel dat mensen zich niet moreel verantwoordelijk voelen voor gedrag dat ooit is geïnstitutionaliseerd.

Gedrag[3] kan geïnstitutionaliseerd[4] worden in een model[5], een voorwerp, een gewoonte, een proces, een regel of een wet, maar ook in een organisatie, een beroep, een abstractum, een medemens zelfs. Dat worden dan evenzoveel adiaforiserende instituties.[6]

Gedrag wordt geïnstitutionaliseerd door expliciete regels, maar vooral door -perceptie van- impliciete, sociale regels.

Institutionalisering leidt altijd een tot reductie van diverse, individuele evoluerende gedragingen en opvattingen tot een monolithisch, generiek, onveranderbaar gedrag.[7]

Adiafoor gedrag is heteronoom gedrag. Het wordt gestuurd door gepercipieerde regels van instituties, niet door eigen afwegingen. Heteronoom gedrag beredeneert[8] zich niet, het voegt zich naar de institutie. Ik vind dat minder ethisch.

Ethisch vind ik gedrag dat altijd kritisch de omringende én de eigen regels beredeneert, en na toetsing aan andere redeneringen tot een autonome[9] afweging voor gedrag komt.

Afschrikwekkend voorbeeld: Trinity, the gadget

16 juli 1945 om half zes in de ochtend slaagde het geheime Manhattan-project. Dankzij de succesvolle detonatie van de eerste atoombom, codenaam “Trinity”[10], bijnaam “The gadget” was de wereld een vernietigingswapen rijker, vier keer sterker dan berekend, en duizend keer krachtiger dan de grootste bom tot dan toe.

Een YouTube-filmpje toont drie reacties van betrokkenen: [11]

- Projectleider generaal Leslie R. Groves lag in een stofjas voorover op de grond, en peinsde “Wat nou als het ding niet afgaat?”.

- Philip Morrison, professor aan het MIT, ervoer dat de warmte van de explosie zijn gezicht verwarmde, “precies zoals een zonsopgang dat doet”.

- Edward Teller, natuurkundige van joods-Hongaarse afkomst, liefkozend “de vader van de waterstofbom” genoemd, besefte, dat de bom tegen Japan gebruikt zou gaan worden, “en dan niet als experiment”.

De reactie van Teller is de minst adiafore van de drie, de enige die een ethische kanttekening maakt bij dit technisch-wetenschappelijke hoogstandje, en deze later ook in een verklaring in een hoorzitting kenbaar maakt -tegen de daar heersende communis opinio in.[12]

Algoritmen:

de natte droom van iedere bureaucraat

Algoritmen zijn de digitale loot aan de stam der adiaforiserende instituties. En een triest voorlopig hoogtepunt[13] in de heteronomisering van onze samenleving.

Ze hebben vooral in beleid en bestuur een krachtige adiaforiserende werking, omdat er een gelaagde institutionalisering optreedt, die per laag het zicht op de menselijke relatie en op het politieke doel verder vertroebelt.[14]

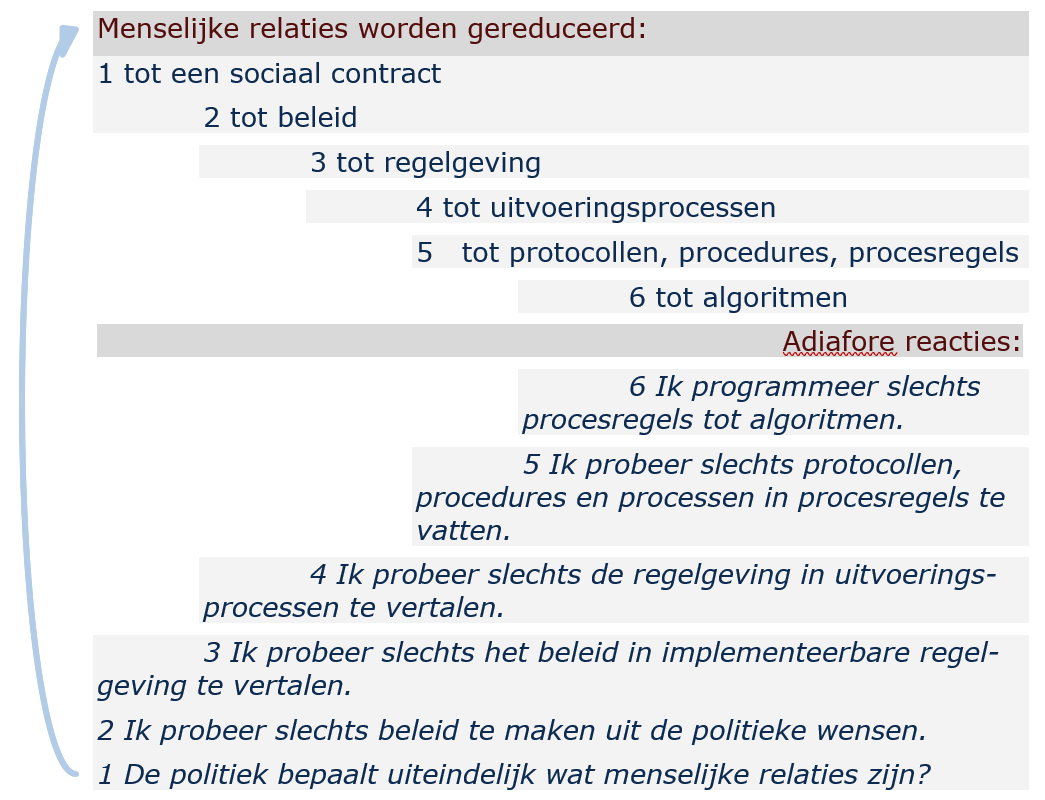

Menselijke relaties worden in dat proces gereduceerd tot een sociaal contract, tot beleid tot regelgeving, tot uitvoeringsprocessen, tot procesregels, tot algoritmen.

De Belastingdienst, bijvoorbeeld[15], heeft processen voor terugvordering van te veel verstrekte voorschotten op toeslagen in algoritmen gevat en gedigitaliseerd.[16]

Dat leidt tot een veelvoudige reductie: een mens is met een set beslisregels in een beleid gereduceerd tot “toeslaggerechtigde”, die is gereduceerd tot een aantal variabelen in parameters van de procesregels, die zijn gereduceerd tot getallen, die zijn gereduceerd tot een reken-formule.[17]

De toeslag verlenende ambtenaar is in het proces gereduceerd tot een algoritme dat elders verzonnen en veralgoritmiseerde procesregels digitaal uitvoert.

De algoritmen bepalen uiteindelijk, maar kunnen onbedoelde, schrijnende of Kafkaëske situaties niet waarnemen.[18]

Het adiafore effect is, dat ambtenaren en politici mogen zeggen: sorry, volgens de uitvoeringssystematiek moet u terugbetalen, daar kunnen wij niet anders op beslissen. [19]

Terwijl zij als mens én als professional, geconfronteerd met een concreet uitvoeringsgeval, wellicht anders zouden beslissen.

Ethisch zou het zijn, als elk geautomatiseerd proces voor alle actoren en betrokkenen een eenvoudige “stopknop” zou hebben.[20] “Indrukken” daarvan zou ervoor moeten zorgen dat het proces vanaf dat moment verder “handmatig” en in dialoog uitgevoerd wordt, liefst inclusief reflectie op de procesregels, en inclusief terugkoppeling van verbetervoorstellen voor alle institutionele lagen.[21]

Trap af, trap op, van menselijke relatie tot algoritme

Bestuurlijke processen worden in zes stappen gereduceerd tot algoritmen.

Bij ieder van die stappen past een adiafore reactie.

Aanzetten tot kritisch bevragen van Adiaforie en algoritmen.

Deze twee aanzetten tot kritische beschouwing van adiafore relaties en van algoritmen kunnen helpen uw redeneringen meer autonoom te maken.

Aanzet tot een ethische checklist adiafore relaties

Een adiafore relatie kan kritisch beschouwd worden. Die beschouwing kan leiden tot een meer autonome relatie. Beschouwen kan bijvoorbeeld middels deze -aan uw wensen aan te passen- ethische checklist.

- Welke gedrag observeert u?

- Hoe is dat gedrag geïnstitutionaliseerd?

- Voor wie heeft dat gedrag consequenties?

- Welke expliciete regels gelden hier?

- Welke impliciete regels gelden hier?

- Welke van die regels vindt u problematisch?

- Wat is er gereduceerd tot wat?

- Wat zou u hier doen als u autonoom zou kunnen handelen?

- Wat houdt u tegen?

Aanzet tot een heuristiek voor autonome bevraging van algoritmen

Deze heuristiek benoemt aspecten van algoritmen, en bevraagt die autonoom-kritisch.

Uw antwoorden op deze pakweg tien vragen vormen uw autonome beoordeling van een algoritme en zijn toepassing.

Een algoritme werkt met data

Een ei krijg je niet in een computer. Het woord ei wel, het aantal eieren in een mandje ook. Een kind past niet in een computer. Een CITO-score wel.

Data representeren verbale of numerieke representaties van de werkelijkheid. Representatie in het kwadraat dus eigenlijk.

Elke representatie is ook een reductie van de werkelijkheid tot dat wat te tellen of dat wat te vertellen is. Data zijn dus eigenlijk reducties in het kwadraat.

Bij elke reductie verlies je iets.

Wat is er bij de reductie in uw data verloren gegaan?

Wat is daar, voor wie erg aan?

Algoritmen zoeken in datasets naar correlaties

Er is een correlatie tussen de kleur van een auto en het aantal veroorzaakte ongelukken. Er is een correlatie tussen het aantal PK’s van een auto en het aantal veroorzaakte ongelukken.

De uitkomst van een algoritme leunt zwaar op die correlaties. Maar een correlatie is nog geen causaal verband. Een correlatie kan toeval zijn. Of het gevolg van een bias in de data.

De output van een algoritme wordt echter bijna altijd beschouwd als een causale predictie.

Een algoritme zou alleen gebruikt mogen worden, als alle causale verbanden geëxpliciteerd en onderbouwd zijn.

Welke correlaties gebruikt uw algoritme?

Is voor elke correlatie een causaal verband geëxpliciteerd en onderbouwd?

Een algoritme redeneert

De basisredenering voor een algoritme is altijd deze:

ALS 1 EN/OF 2 DAN 3. Deze oervorm kan genest worden: ALS 01 EN/OF 02 DAN 1.

Deze basisredenering kan naar believen van de argumentatiediepte gekoppeld worden, en hij kan gekwantificeerd worden. De meest spectaculaire ALS-sprong is die van de redenering naar de werkelijkheid.

De redeneringen achter algoritmen worden zelden geëxpliciteerd. Vaak zijn alleen delen van een redenering bekend bij een ontwikkelteam. En maar zelden nemen algoritmebouwers de moeite de premissen onder hun redeneringen in voldoende diepte tot geneste of gekoppelde redeneringen te expliciteren.

Voor de relatie tussen redenering en werkelijkheid wordt, helaas niet altijd terecht, vertrouwd op de kwaliteit van de data gebruikt voor training en input.

Wil een algoritme beoordeel kunnen worden, dan zal de redenering geëxpliciteerd moeten zijn. Die geëxpliciteerde redenering zal getoetst moeten worden aan de paradigma’s van het vakgebied waarbinnen het redeneert.

Zijn al uw redeneringen geëxpliciteerd?

Zijn alle redeneringen getoetst aan paradigma’s?

Een algoritme wordt gevoed met descriptieve data, correlaties en causaties.

Als er in een Nederlandse zin een dingwoord staat (znw) dan staat er altijd zo’n lullig klein woordje voor (lidw). Er zijn drie van die woordjes: de | het | een. Er kunnen woorden tussen het (znw) en het (lidw) staan.

Bijna alle algoritmen worden met descriptieve data gevoed. Dus zou de output ook descriptief moeten zijn. Veel output van algoritmes wordt echter prescriptief gebruikt. Maar dat iets is, wil nog niet zeggen dat iets moet zijn. We kunnen morgen alle lidwoorden door “dn” vervangen, als we dat willen, bijvoorbeeld, en ze achter de znw zetten.

“Prescriptivering” is een van de sterkste, maar minder zichtbare heteronomiserende effecten van algoritmen -zeker als er ook nog een fikse bias of lacune in de data zit.

Prescriptief gebruik van een output vergt een extra regel van buiten het domein van het algoritme om er een voorschrift van te kunnen maken. Die extra regel zal uit een geaccepteerd legitimerend domein moeten komen.

Welke uitkomsten van uw algoritme worden prescriptief gebruikt?

Voor welke uitkomsten is er een expliciete legitimerende regel “van buiten” die hem prescriptief maakt?

Met de uitkomsten van een algoritme wordt altijd gespeeld.

Het ministerie van OCW heeft liften die met een algoritme hun optimale “route” berekenen. In de lifthal toetsen lifters het nummer van de etage van hun keuze op een zuil. Het algoritme bepaalt dan welke liften in welke volgorde de aanvragen afhandelen. En dat is best een knap algoritme. De ambtenaren van OCW hadden echter al snel door, dat ze door hun etage een paar keer achterelkaar in te toetsen de uitkomsten naar hun hand konden zetten, wat ze een persoonlijke expresslift opleverde. Het algoritme kon niet zien of er echt tien mensen naar de 13e etage wilden, of dat een persoon tien keer achtereen 13 toetste. Gelukkig bood een streng kijkende bode, geposteerd naast de zuil met toetsen, uitkomst.

De output van een algoritme komt altijd in een ecosysteem terecht. Vooraf is maar ten dele te bedenken hoe andere actoren in dat systeem op de output zullen reageren. Als de output de actoren niet bevalt, zullen ze hem saboteren -zie het liftvoorbeeld. Als de output enthousiast omarmd wordt daarentegen, zal hij meer effect hebben dan verwacht.

De outcome van de output is afhankelijk van de perceptie van de output door de actoren. Een onvoorziene perceptie leidt vaak tot een andere outcome. In ons liftvoorbeeld verandering van optimaliseren van de outcome voor een collectief tot optimaliseren van de outcome voor een individu.

Vaak is een ongewenste outcome niet te verminderen door terugkoppeling in het algoritme. Dan biedt alleen input van buiten het algoritme uitkomst. Een streng kijkende bode bijvoorbeeld.

Met welke uitkomsten van u algoritme kan gespeeld worden?

Wie in uw ecosysteem zou er waarom mee willen spelen?

[1] Vrij naar Niels Bohr: “Never express yourself more clearly than you are able to think.”

[2] Adiaphoron (/ædɪˈæfərɒn/, /ædiˈæfərɒn/[1][2] plural: adiaphora from the Greek ἀδιάφορα, the negation of διάφορα – Latin differentia – meaning “not differentiable”).

Ik gebruik de term zoals de Stoïcijnen die gebruikten:

“The Stoics distinguish all the objects of human pursuit into three classes: good, bad, and adiaphora (indifferent). Virtue, wisdom, justice, temperance, and the like, are denominated good; their opposites were bad. Besides these there are many other objects of pursuit such as wealth, fame, etc. of themselves neither good nor bad. These are thought therefore in ethics to occupy neutral territory, and are denominated “adiaphora”. This distinction amounts practically to an exclusion of the adiaphora from the field of morals.[7]” Zie hier

[3] Gedrag is de verzamelterm voor alle waarneembare handelingen in de werkelijkheid. Denken kan ook gedrag zijn, maar is pas waarneembaar als het gecommuniceerd wordt.

[4] De term institutionalisering wordt veel gebruikt in sociale theorieën om te verwijzen naar het proces iets te plaatsen (bijvoorbeeld een concept, een sociale rol, een bepaalde waarde of een gedragswijze) binnen een organisatie, sociaal systeem, of de samenleving als geheel. Zie hier

[5] Alle modellen reduceren onze relatie met “de wereld”. Woorden, schema’s tabellen, concepten, afbeeldingen zijn evenzovele modellen.

Door hun reductie heteronomizeren modellen onze relaties. Dat schept ruimte om ze naar believen te kleuren.

[6]Elk instituut is de resultante van een aantal reducties. Waar ethiek weg gereduceerd wordt, ontstaat ruimte voor adiaforie.

[7] De heftigste reductie is die van de “wereld” of “werkelijkheid” naar taal of naar getal.

De vraagstukken rond deze reductie worden al eeuwen bestudeerd in taalfilosofie, semiotiek en wiskunde. Bijzonder vind ik, dat in de discussie rond implementatie van data en AI weinig argumenten te vinden zijn uit de paradigma’s van die wetenschapsgebieden.

[8] Communiceren van denken noem ik redeneren. Pas als je gedachten in redeneringen communiceert, kun je ze aan die van anderen toetsen, kun je tot een autonome afweging komen.

[9] De term is afgeleid van het Grieks αυτονομία: autonomía ‘onafhankelijkheid’ (< αυτόνομος autonomos ‘geregeerd door eigen wetten’ < autoς autos ‘zelf’ + νόμος nomos ‘wet’). Het concept komt voor in politiek, technisch, filosofisch, geneeskundig, moreel en psychologisch verband, en verwijst naar de capaciteit van een rationeel individu of bestuur om eigen verantwoorde beslissingen te nemen. Zie hier

[10] Trinity betekent “drievuldigheid”: vader, zoon en heilige geest. “Ruiters van de Apocalyps was een adequatere benaming geweest?”

[11] https://www.youtube.com/watch?v=Ru2PWmGIoB8

[12] Hij is daarop lang met de nek aangekeken, maar bleef desondanks een advocaat voor nucleaire bewapening en kernenergie:

“Teller was an early member of the Manhattan Project, charged with developing the first atomic bomb, and proposed the solid pit implosion design which was successful. He made a serious push to develop the first fusion-based weapons as well, but these were deferred until after World War II. (…) After his controversial negative testimony in the Oppenheimer security hearing convened against his former Los Alamos Laboratory superior, J. Robert Oppenheimer, Teller was ostracized by much of the scientific community. He continued, however, to find support from the U.S. government and military research establishment, particularly for his advocacy for nuclear energy development, a strong nuclear arsenal, and a vigorous nuclear testing program.” https://en.wikipedia.org/wiki/Edward_Teller

[13] Vorige hoogtepunten waren (zijn) religie, communisme en fascisme, massamedia en sociale media. (Combinatie levert bonuspunten op.) Volgend hoogtepunt wordt een soort singulaire quantum-intelligentie, wedden?

[14] Data en algoritmen zijn modellen van de derde categorie. Die heteronomizeren niet alleen onze relaties, die vervreemden ons van wat wij koesteren als “relaties”.

[15] UWV en DUO en het medisch-industrieel zorgcomplex kunnen er ook wat van.

[16] Ook het invorderen is gedigitaliseerd, waardoor de overheid nu een grote veroorzaker van schuldproblematiek is.

[17]Kwantificeren is een beruchte reductie. Meten is weten -wat je kunt meten. Dat kan een hardnekkige bias opleveren.

[18] Alleen rücksichtslos terugclaimen van onze autonomie kan ons ervan redden, als datazombies in een algoritme-tehuis te eindigen.

[20] Zaagbanken, drukpersen en andere gevaarlijke machines hebben al zo’n knop. Waarom digitale machines nog niet?

[21] Laten we daar een gele knop aan toevoegen: proces stapt terug in de tijd tot aan de betwiste beslissing. En dan ook maar een blauwe: functionaris overruled de betwiste processtap op individuele ethische gronden.